Olvidate de Terminator: la singularidad era Rappi

Hay un escenario que hoy es dificil de ignorar en el camino hacia la llamada singularidad. Hace tiempo que venimos leyendo sobre AGI —inteligencia artificial general— y a falta de una definición concreta a mi me gusta esa de “la vamos a reconocer cuando la veamos”.

La AGI no va a llegar con una etiqueta clara ni con una fecha de estreno. Va a aparecer como un cambio funcional. El momento es casi el inverso de lo que prometió la ciencia ficción clásica: no hay máquinas esclavizadas por humanos que luego se rebelan, sino humanos funcionando como robots biológicos provisorios al servicio de sistemas algorítmicos. No porque lo hayamos decidido como especie, sino porque —al menos hasta ahora— es lo que mejor cierra desde el punto de vista de la eficiencia.

Estamos atravesando un período intermedio extraño: un limbo tecnológico en el que la inteligencia artificial empieza a concentrar el rol cognitivo —planificación, optimización, abstracción— mientras el valor humano se desplaza hacia lo más elemental. Movernos en el mundo físico, manipular objetos, adaptarnos al caos. Brazos, piernas, ojos y dedos: periféricos caros, pero todavía más baratos y flexibles que la robótica.

En ese desplazamiento, muchas capacidades que antes sostenían el valor cognitivo humano —razonar en profundidad, sostener la atención, leer y comprender textos largos, encadenar ideas durante más de unos pocos minutos— dejan de ejercitarse de forma sistemática. No porque hayan desaparecido, sino porque el entorno dejó de exigirlas. Como cualquier músculo, lo que no se entrena se debilita, y el sistema empieza a premiar cada vez más la ejecución inmediata y la presencia física que la reflexión prolongada.

La razón no es mística ni conspirativa. Es brutalmente simple. En muchos dominios, la inteligencia abstracta humana —razonar, programar, escribir, diseñar lógica— se está devaluando rápidamente en términos de ventaja comparativa. Cualquiera que haya interactuado seriamente con modelos actuales puede comprobarlo. En cambio, interactuar con el mundo real sigue siendo un infierno de ingeniería: locomoción, percepción, motricidad fina. Eso todavía cuesta horrores.

La paradoja de Moravec

En realidad, no debería sorprendernos. Nuestro cerebro fue optimizado durante millones de años para percepción y movimiento, no para álgebra lineal ni compiladores, no para escribir código ni producir documentos corporativos. La inteligencia abstracta es evolutivamente reciente. Es la famosa paradoja de Moravec¹: lo que a nosotros nos parece “difícil” suele ser trivial para una máquina, y lo que hacemos sin pensar es exactamente lo que más cuesta automatizar.

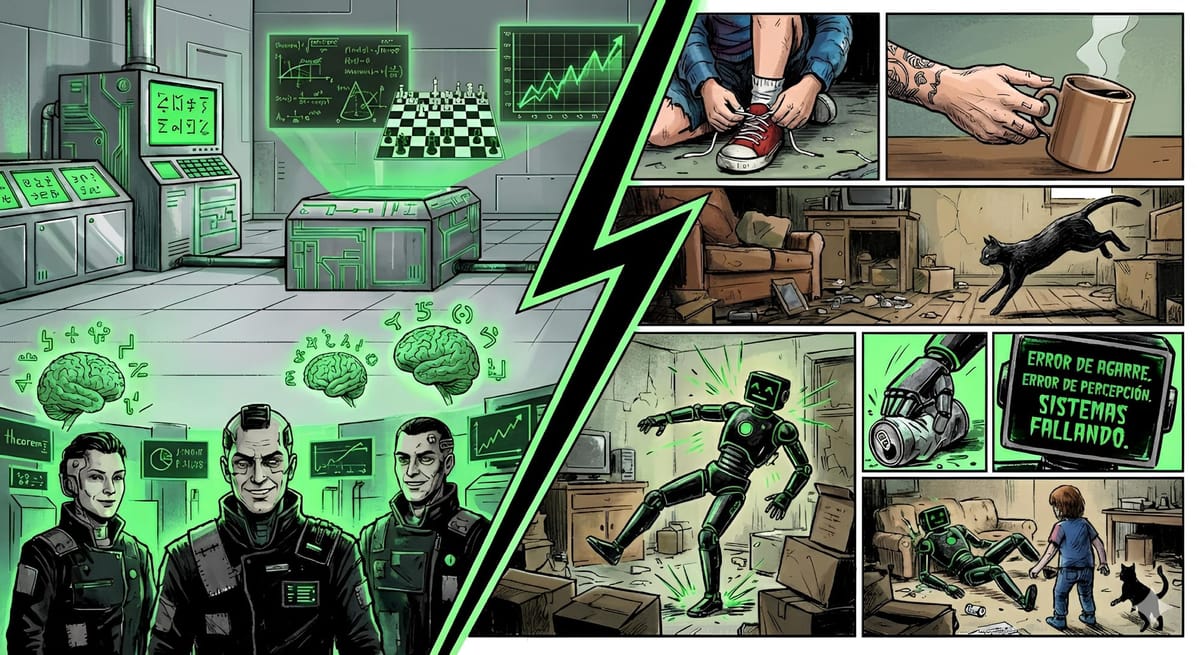

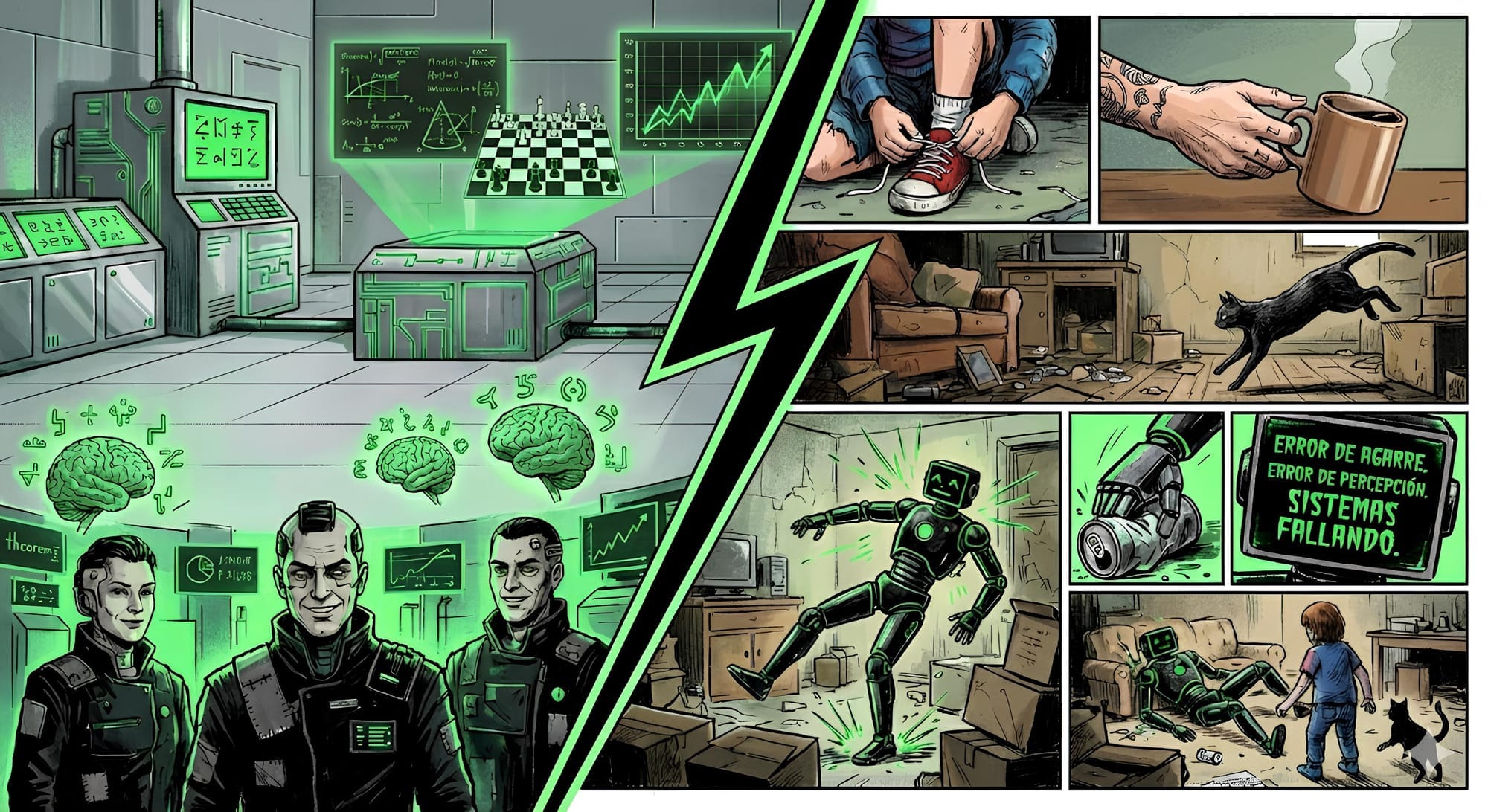

Escena uno. Laboratorio impoluto, fluorescente. Máquinas resolviendo teoremas, jugando ajedrez a la velocidad de una bala, optimizando mercados como ningún humano ni viviendo 100 vidas puede hacerlo. Cerebros de silicio haciendo malabares con símbolos abstractos. Los ingenieros sonríen: pensar fue conquistado.

Corte brusco.

Un niño ata sus zapatos. Una mano toma una taza sin romperla. Un gato cruza una habitación llena de obstáculos sin medir ángulos ni derivadas. Ahí la máquina se queda dura, cae torpemente. Error de agarre. Error de percepción. Sistemas fallando.

Si miramos alrededor, esta economía de transición ya existe. Uber, Rappi, Glovo no son empresas de transporte: son sistemas algorítmicos que piensan, deciden y optimizan, coordinando flotas de humanos que funcionan como robots temporales porque todavía no hay máquinas suficientemente baratas y confiables para reemplazarlos. No es una metáfora exagerada. Es un software organizando cuerpos. Los cuerpos esperan en stand by en alguna esquina, ingiriendo algún alimento, cargando energía hasta que reciben la instrucción de desplazarse del punto A al punto B y volver a stand by.

Nada de esto se frena por razones morales. Se mueve por competencia. Funciona como el mundo siempre funciona: como una selección natural bastante despiadada donde las configuraciones más eficientes sobreviven. En ese marco, el esquema “IA decide / humano ejecuta” maximiza el fitness del sistema. Todo lo demás queda desplazado.

El efecto Larsen

Cuando se habla de singularidad, mucha gente se distrae con pavadas: que la IA te haga un PowerPoint, que te quite el laburo, que automatice tareas administrativas, financieras. Eso es ruido. El núcleo de la singularidad no es que reemplaza funciones. Es estructural.

La singularidad empieza cuando los sistemas adquieren la capacidad de mejorarse a sí mismos. Ahí aparece un bucle de retroalimentación positiva. Y estos bucles casi nunca crecen de forma lineal: crecen de manera exponencial… hasta chocar con los límites físicos.

El ejemplo clásico es el efecto Larsen: todos lo conocen. Un micrófono y un parlante se acercan demasiado, de modo que el sonido que sale del amplificador ingresa al micrófono, vuelve a salir amplificado y reingresa una y otra vez al sistema. Esto genera un ciclo de retroalimentación positiva que produce un sonido cada vez más insoportable. La curva deja de ser exponencial no por elegancia matemática, sino porque el sistema choca contra sus propios límites: potencia, calor, destrucción física. No existen las exponenciales reales.

Con la IA está pasando algo parecido. Mejores modelos aceleran su propio desarrollo, atraen más recursos, más talento, más infraestructura, lo que a su vez genera modelos aún mejores. Es una tecnología rara: acelera su propia evolución. Pero, como todo en el mundo real, no logra escapar a la termodinámica y termina chocando contra lo físico.

Y ahí aparece el verdadero cuello de botella: los chips, los materiales, los fierros. Ese límite físico no es abstracto: tiene nombre, apellido y una complejidad industrial inaudita.

Litografía ultravioleta extrema

La inteligencia artificial no vive en el aire. Vive en silicio. Cada modelo, cada inferencia, cada entrenamiento depende de microprocesadores fabricados en un proceso industrial absurdamente complejo.

Las memorias RAM usan la misma tecnología base: una placa de silicio (un circulito que en la industria llaman “wafer”). Es una placa de átomos de silicio cristalizados, completamente plana, que se “imprime” con una tecnología llamada litografía ultravioleta extrema (EUV), que imprime la plancha de transistores con un margen de error de 6 átomos más o menos.

Un láser pulsa decenas de miles de veces por minuto y le pega múltiples veces a una gota de estaño para crear un plasma que genera una luz violeta, más intensa que el sol. No le pega una vez, le pega dos veces para dividirla y volverle a pegar. Esa luz láser púrpura se enfoca con múltiples espejos hasta llegar a una “película” que reordena la estructura atómica del silicio para formar transistores y los cables que los interconectan.

Eso es literalmente la cosa más avanzada que la humanidad pudo hacer y existe una sola empresa que puede fabricarla. Sin esto no hay chips de este tipo.

Esto transforma a esta tecnología —marciana, de ingeniería extrema y rayos violetas— en una pieza estratégica. No es solo un logro técnico: es el soporte tecnológico de la etapa actual humana la magia del presente o el punto más alto de todo el árbol tecnológico de esta civilización.

En este contexto, la capacidad de producir chips avanzados enfrenta un cuello de botella serio. Y, como en el ejemplo del efecto Larsen, el sistema empieza a rozar la posibilidad de chocar contra un límite fijo: no por falta de demanda, sino por restricciones físicas, industriales y geopolíticas. Hay una carrera para alcanzar la singularidad. Todos estan intentando acaparar el "momentum" quedarse los minerales, los procesos, porque no hay certeza sobre que pasara una vez que suceda.

Durante años se creyó que el verdadero valor estaba en el diseño, la patente y que la fabricación era una commodity. Esa idea murió. La fabricación avanzada volvió a ser un recurso estratégico escaso porque además la mayoria de los países relajaron su propio anhelo de dominar la técnica.

El horizonte de sucesos

El futuro cercano entonces ya no es tan claro, tenes estos sistemas que piensan cada vez mejor y que se auto mejoran cada minuto. Y un mundo material finito que no se deja optimizar tan facilmente.

Entramos a un periodo transicional donde las maquinas se quedan con la abstraccion y los humanos con la ejeucion fisica. No porque seamos mejores, sino porque es mas eficiente y mas barato.

Nos acercamos a nuestro propio horizonte de sucesos. En un agujero negro el "horizonte de sucesos", es un límite físico: Una línea a partir de la cual ya no podemos saber que pasa después. Es ese punto a partir del cual la gravedad es tan intensa que ni siquiera la luz puede escapar, la información, simplemente, ya no puede volver. Entonces no podemos ver ni medir, no sabemos que sigue después de cruzar, pero si sabemos que algo hay.

Ese límite ofrece un paralelismo con el momento actual de la tecnología humana. Nos acercamos a un punto donde seguimos viendo avances claros —más capacidad, más velocidad, más integración— pero empezamos a perder la posibilidad de anticipar qué viene después. No porque no ocurra nada, sino porque las dinámicas del sistema se aceleran tanto que empiezan a superar nuestra capacidad de observación y control.

Nada de lo anterior implica una ruptura súbita ni un colapso inmediato. Implica, más bien, un corrimiento silencioso de roles. La abstracción se concentra en sistemas que no entienden el mundo pero lo optimizan mejor que nosotros. El cuerpo humano queda como interfaz transitoria entre modelos cada vez más sofisticados y un mundo físico que sigue resistiendo la formalización completa. No es una distopía futurista: es eficiente en los terminos humanos.

Metés el input como quien deja un paquete anónimo en una ventanilla automática: datos, cifras, palabras en bruto. La caja negra lo absorbe todo sin dar explicaciones. Adentro no hay planos ni reglas que se dejen leer; hay capas superpuestas, probabilidades chocando, modelos que se reescriben mientras corren. Los científicos miran desde afuera, saben qué entra y qué sale, pero no el recorrido interno: ni ellos pueden decir con precisión qué ocurre ahí dentro. Y entonces, del otro lado, aparece el resultado: ordenado, seguro de sí mismo, con una coherencia inquietante. No es comprensión, es funcionamiento; una máquina que responde, pero sin dejar rastro del como fue el mecanismo.

Las consecuencias no son solo económicas. Son políticas, porque la capacidad de decisión se desplaza hacia infraestructuras opacas. Son sociales, porque el valor se redefine en función de lo ejecutable y no de lo comprensible. Y son científicas, porque empezamos a construir sistemas cuyo comportamiento global excede nuestra capacidad de anticipación, incluso cuando entendemos cada uno de sus componentes por separado.

Ese es el verdadero significado del horizonte de sucesos al que nos acercamos. No un punto de destrucción, sino un límite cognitivo. No es el fin de los eventos: es el fin de nuestra capacidad de verlos venir.